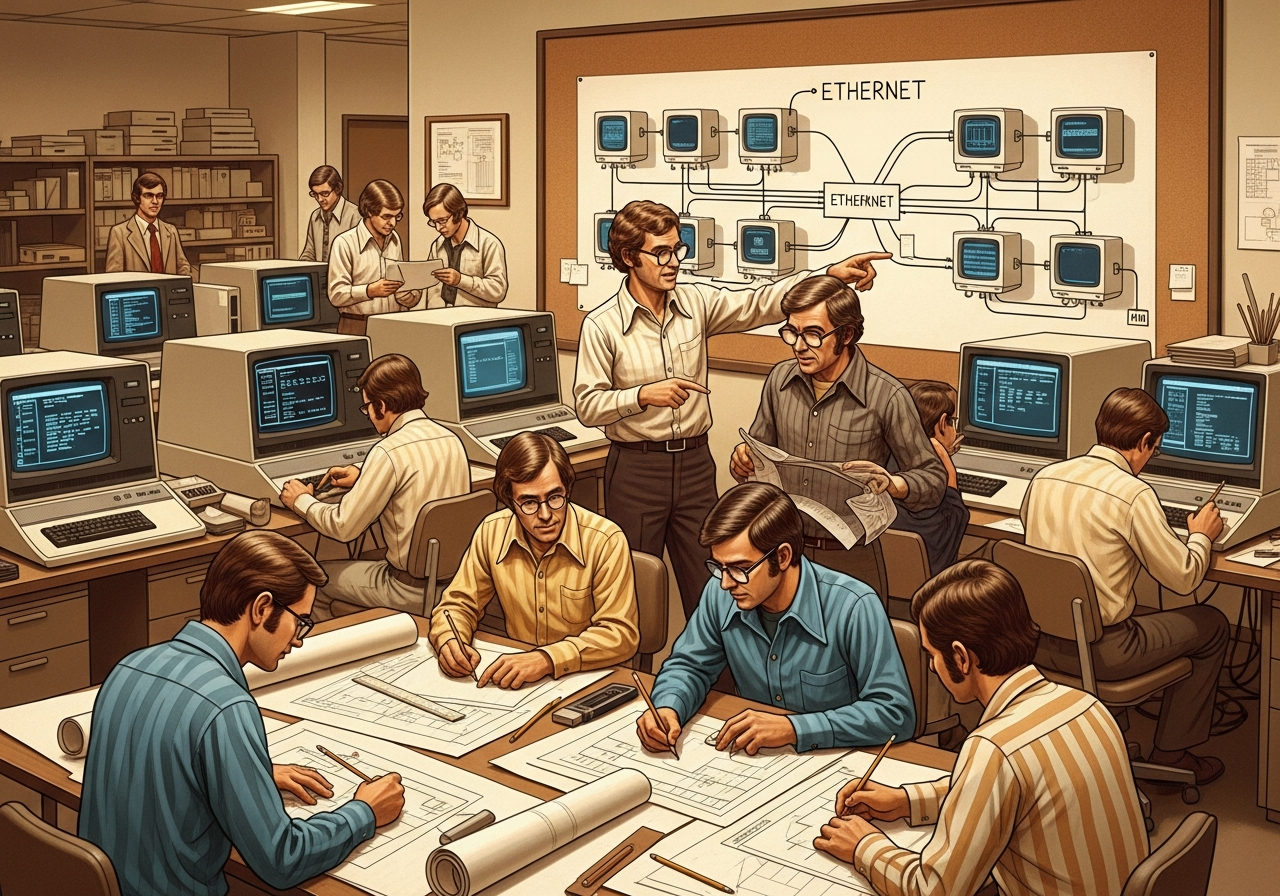

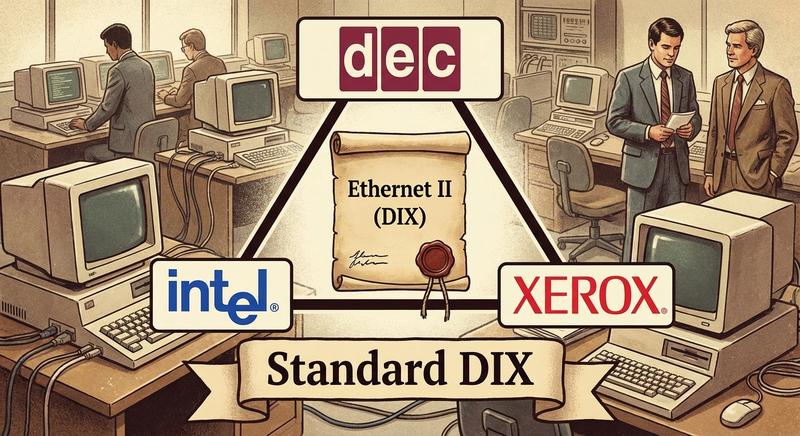

Nasza podróż rozpoczyna się w legendarnym ośrodku badawczym Xerox PARC (Palo Alto Research Center) na początku lat 70. To właśnie tam młody inżynier Robert Metcalfe wraz ze swoim zespołem stanął przed wyzwaniem połączenia nowatorskich komputerów osobistych Xerox Alto z drukarkami laserowymi. Istniejące wówczas technologie sieciowe były zbyt kosztowne i skomplikowane. Potrzebowano rozwiązania prostego, taniego i wydajnego do lokalnej wymiany danych. Tak powstała koncepcja sieci, którą Metcalfe nazwał „Ethernetem", inspirując się XIX-wieczną teorią eteru, czyli hipotetycznego ośrodka wypełniającego wszechświat.