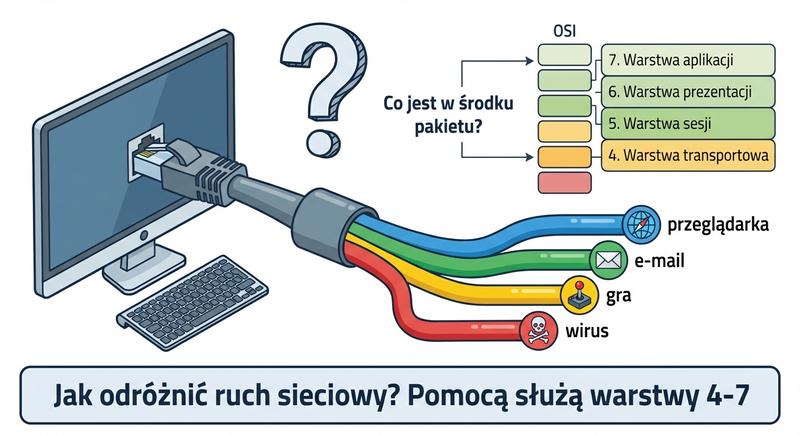

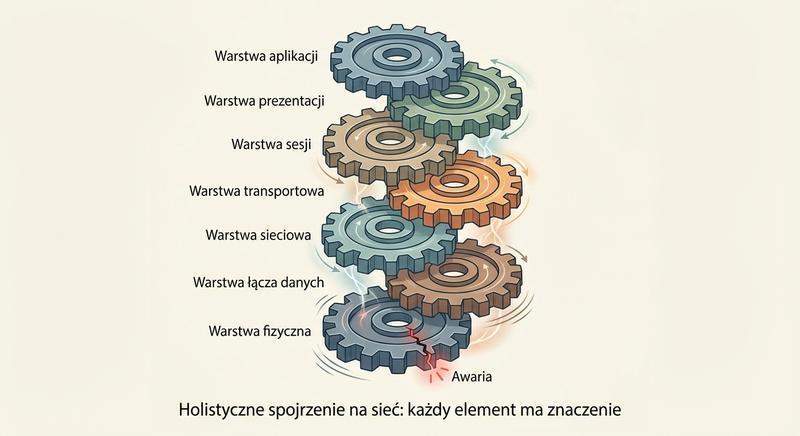

Warstwy 1-3 zapewniły nam dostarczenie pakietu z punktu A do punktu B. To jednak nie wszystko. Pozostają istotne pytania:

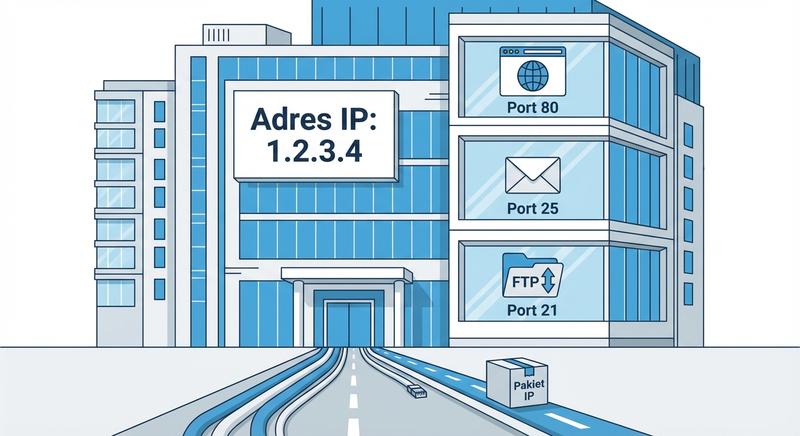

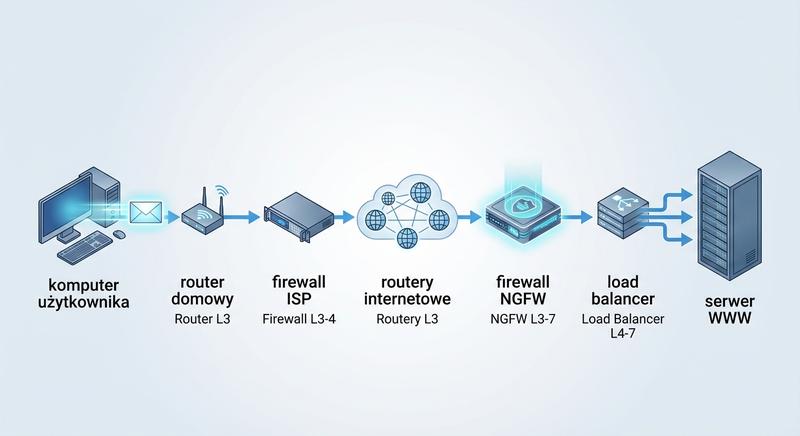

- Jak odróżnić na jednym komputerze ruch z przeglądarki WWW od ruchu poczty e-mail, skoro oba przychodzą na ten sam adres IP?

- Jak zagwarantować, że wszystkie pakiety dotarły w całości i we właściwej kolejności?

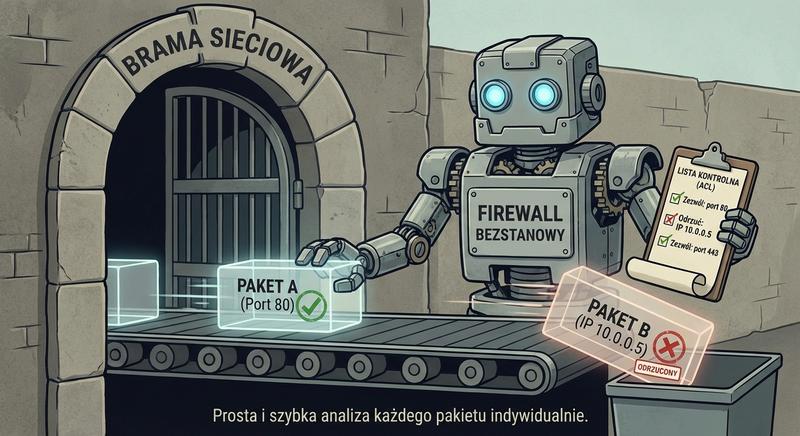

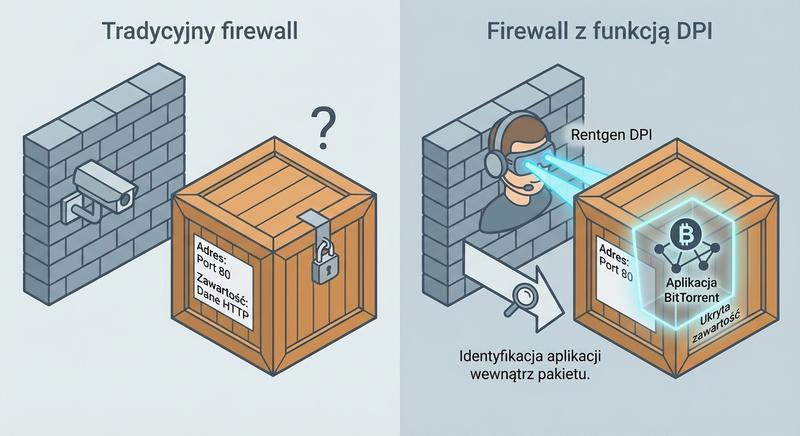

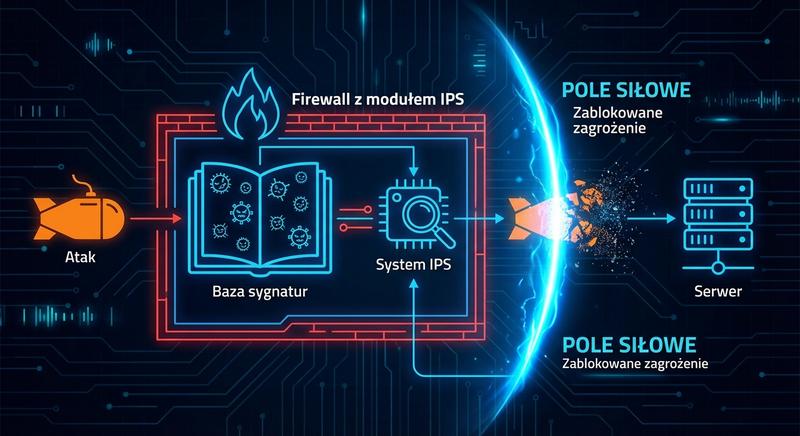

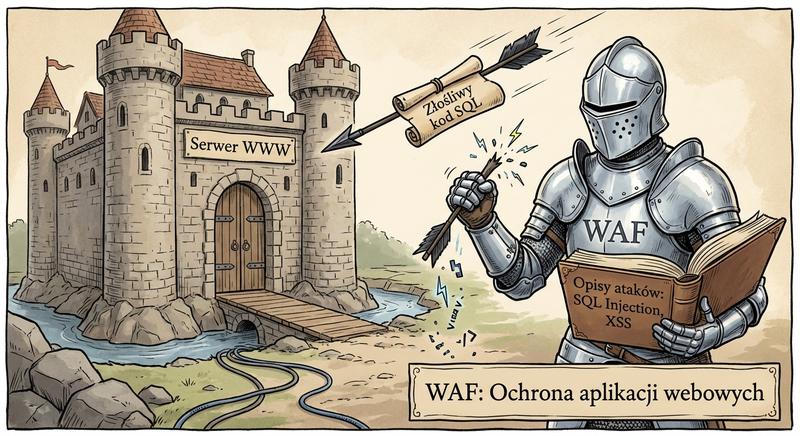

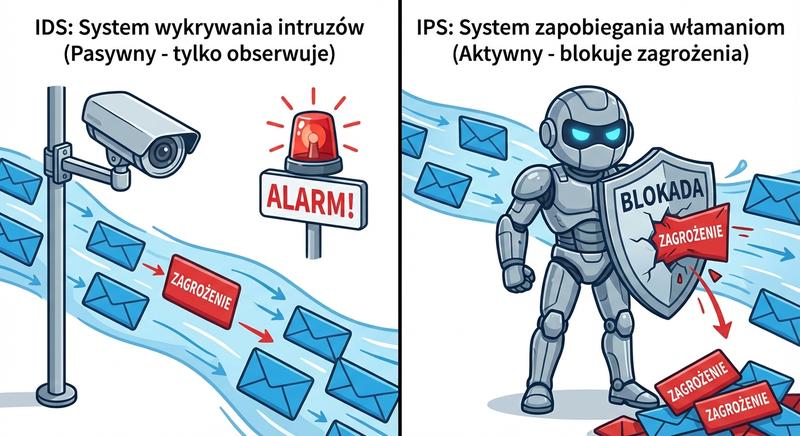

- Jak zabezpieczyć sieć przed atakami wykorzystującymi legalne porty, ale niosącymi złośliwy kod?